AI Mastering ist jetzt kostenlos.

Inhalt kostenlos

- Kostenlose AI-Mastering-Funktionen, die bezahlten Plänen entsprechen (die Mastering-Schutzfunktion wird jedoch abgeschafft)

- App-Version wird abgeschafft

- Kostenlose Desktop-Version veröffentlicht

- Freunde werben, Partnerprogramm abschaffen

- Keine Garantie, grundsätzlich keine Unterstützung

Unterstützung für Premium-Pläne

Wir werden wie folgt antworten.

- Automatische Stornierung nach Ablauf der aktuellen Periode

- Keine Rückerstattung aufgrund einer Stornierung (keine tägliche Rückerstattung)

- Bestehendes geschütztes Mastering wird möglicherweise in Zukunft entfernt

* Die Registrierung über Amazon erfolgt auf die gleiche Weise.

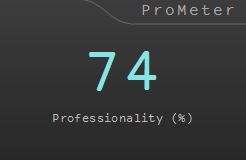

Kostenlose Desktop-Version

Wir haben eine kostenlose Desktop-Version veröffentlicht. Sie können es über den unten stehenden Link herunterladen.

https://github.com/ai-mastering/aimastering-desktop/releases/tag/v0

Funktionen der kostenlosen Desktop-Version

- Keine Registrierung der Mitgliedschaft erforderlich

- Kein Internet erforderlich

- Einige Funktionen sind nicht implementiert

- Keine Garantie, grundsätzlich keine Unterstützung

Hintergrund frei

Es tut mir sehr leid, aber kürzlich habe ich beschlossen, es kostenlos zu machen, da es schwierig ist, AI Mastering zu unterstützen. Wir planen, die kostenlose Desktop-Version zu verteilen und die Desktop-Version und den automatischen Mastering-Algorithmus als Open Source-Version bereitzustellen, damit wir sie weiterhin ohne Unterstützung bereitstellen können.